Environment

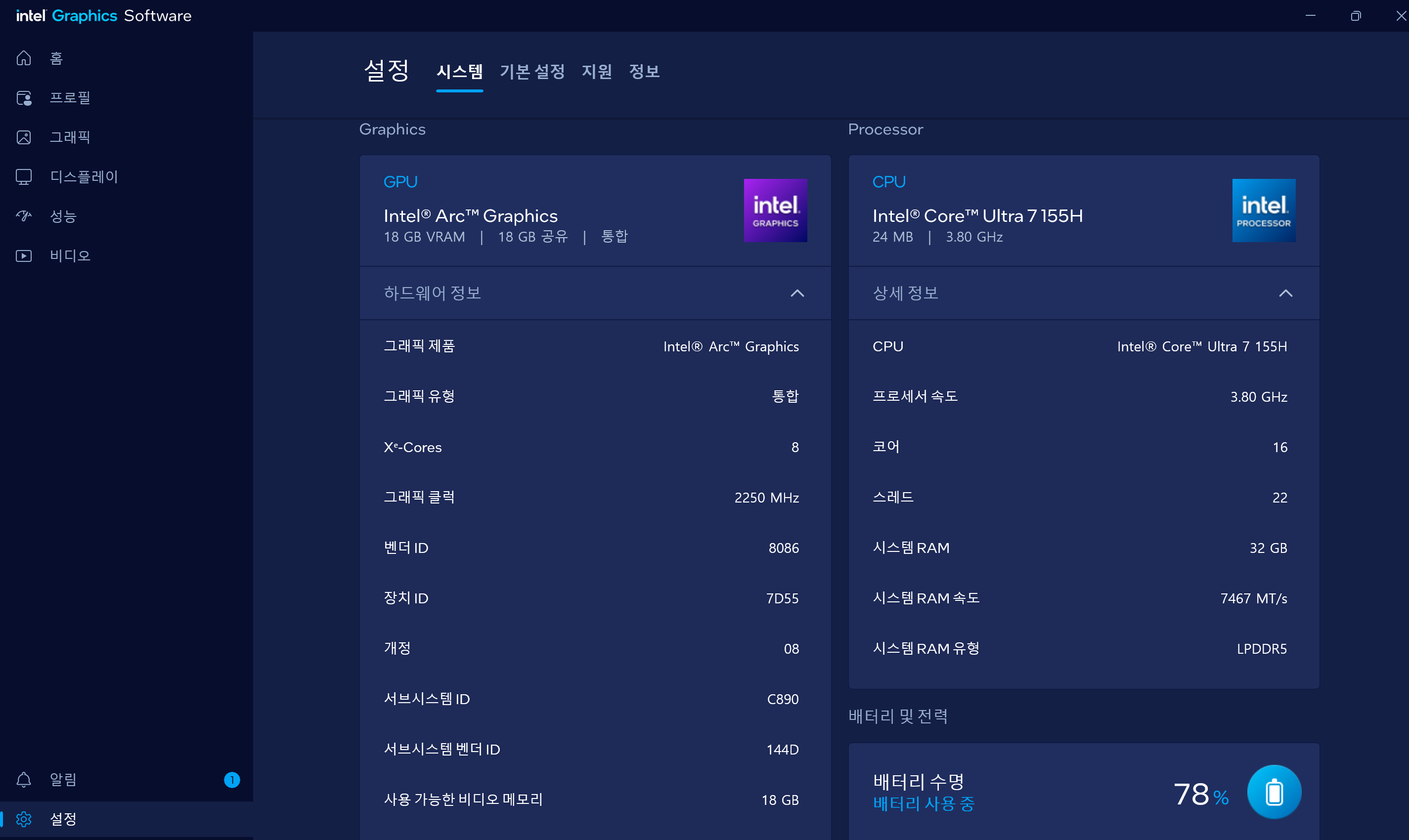

- Laptop Model: Samsung Galaxy Book4 Pro

- OS: Windows 11

- CPU: Intel(R) Core(TM) Ultra 7 155H

- GPU: Intel(R) Arc(TM) Graphics

- RAM: 32GB LPDDR5

- Driver Version: 32.0.101.8735

Ollama 설치

irm https://ollama.com/install.ps1 | iex

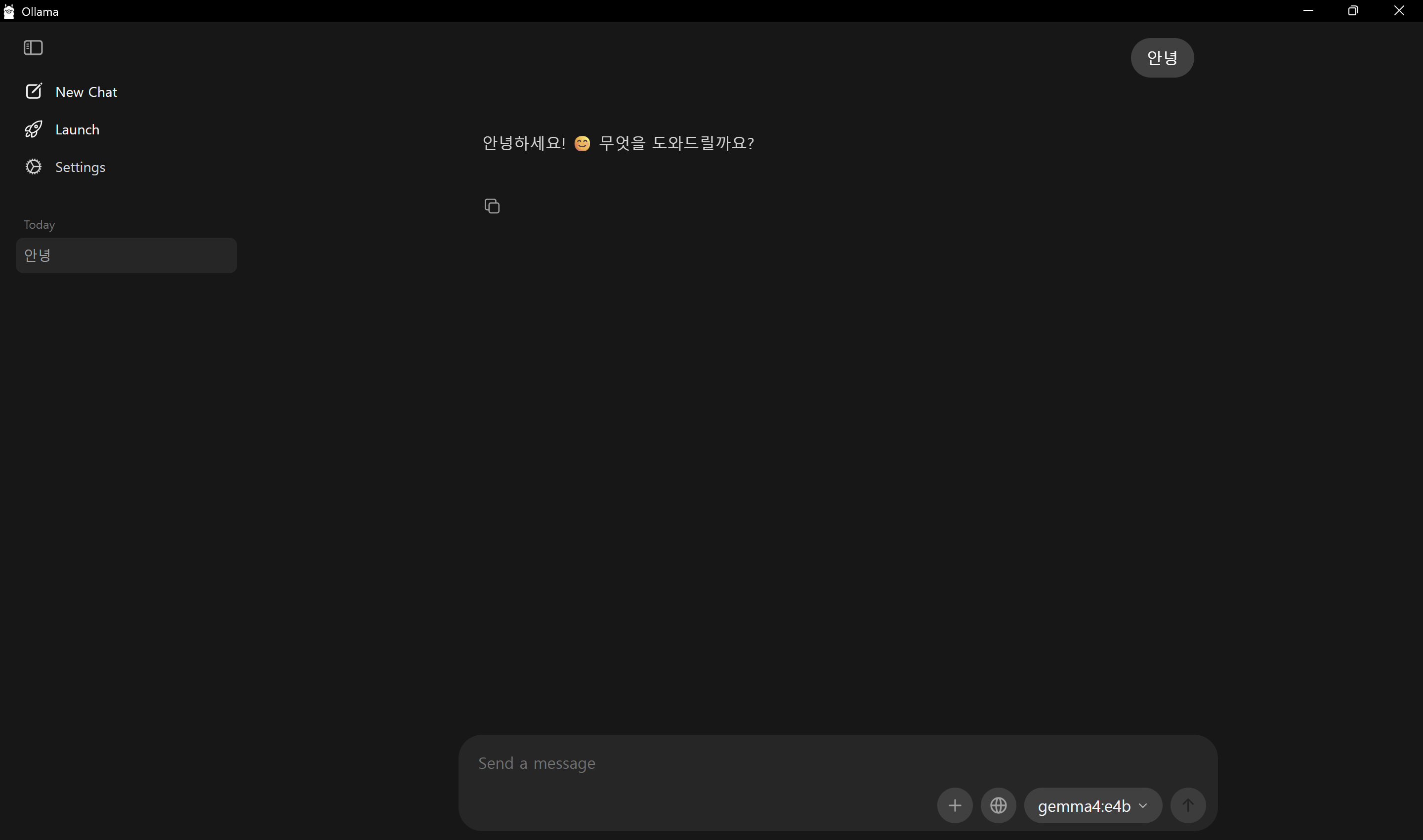

원하는 모델을 고르고, 대화를 시작하면 자동으로 설치가 된다. 4월 초에 출시된 Gemma4 모델을 설치해보았다.

IPEX-LLM

Ollama는 원래 Intel GPU 기반으로 설계되어 있지 않기 때문에 그냥 설치하면 GPU를 활용하지 않고 CPU에서만 실행된다. 따라서, Intel GPU를 활용하기 위해서는 Intel이 만든 라이브러리인 IPEX-LLM을 설치해서, LLM 연산을 Intel GPU의 Xe-core에서 실행되도록 변환해준다.

IPEX-LLM을 설치하는 방법에는 2가지가 있는데, 하나는 Github에서 Portable Zip 파일을 다운로드해서 설치하는 방법이고, 다른 하나는 Python 패키지로 설치하는 방법이다. 나는 Ollama를 통해 모델을 사용할 것이기에 Portable Zip 파일을 다운로드해서 설치하는 방법을 선택했다. 추후에 모델을 직접 제어하고자 할 때 Python 패키지로 설치하는 방법을 시도해볼 예정이다.

https://github.com/intel/ipex-llm/blob/main/docs/mddocs/Quickstart/ollama_portable_zip_quickstart.md

설치 과정은 위의 문서를 참고하였다.

1. Intel Graphics 드라이버 업데이트

사전 요구사항으로 최신 드라이버 버전이 필요하여 Intel Graphics 드라이버를 업데이트하였다.

2. Portable Zip 설치

https://github.com/ipex-llm/ipex-llm/releases/tag/v2.3.0-nightly

위의 링크에서 Portable Zip 파일을 다운로드하였다. 문서에서 제공하는대로 v2.3.0-nightly 버전을 다운로드하였다.

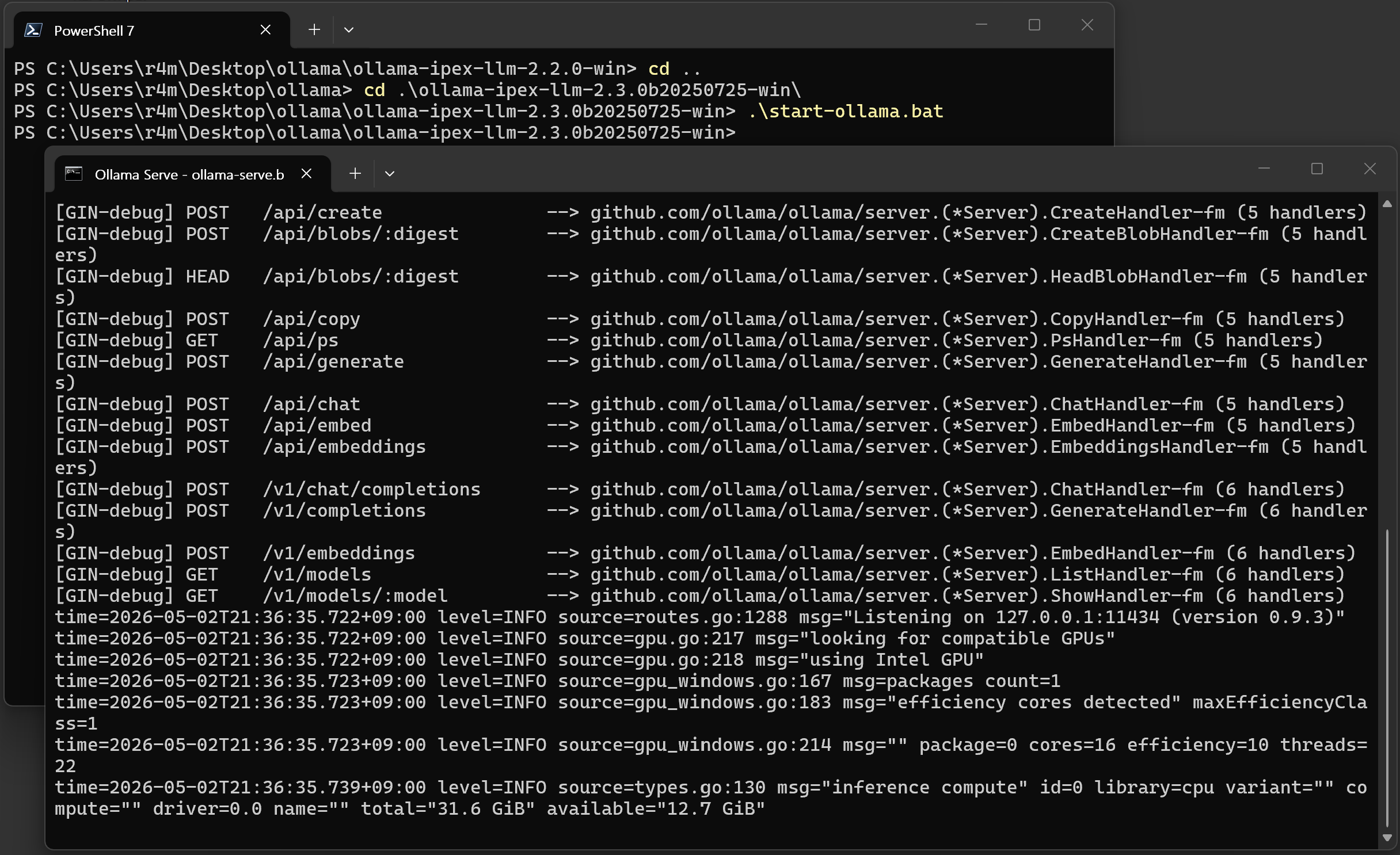

3. Ollama 서버 실행

cd C:\path\to\ipex-llm

.\start-ollama.bat

위의 명령어로 Ollama 서버를 실행하였다.

서버가 실행되면, Ollama가 IPEX-LLM을 활용하여 모델을 실행할 수 있게 된다.

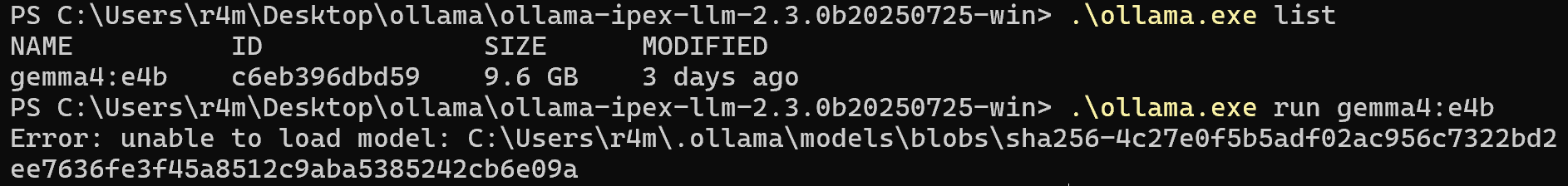

4. Ollama 실행

.\ollama.exe

같은 경로에서 exe 파일을 실행하면 CLI 환경에서 Ollama를 사용할 수 있다.

.\ollama.exe list 명령어로 모델 리스트를 확인할 수 있고, 이전에 설치했던 모델이 정상적으로 설치되어 있는 것을 확인할 수 있다. .\ollama.exe run <모델명> 명령어로 모델을 실행할 수 있는데, 현재 ipex-llm Ollama 버전이 최신 모델을 지원하지 않아 사용할 수 없다..

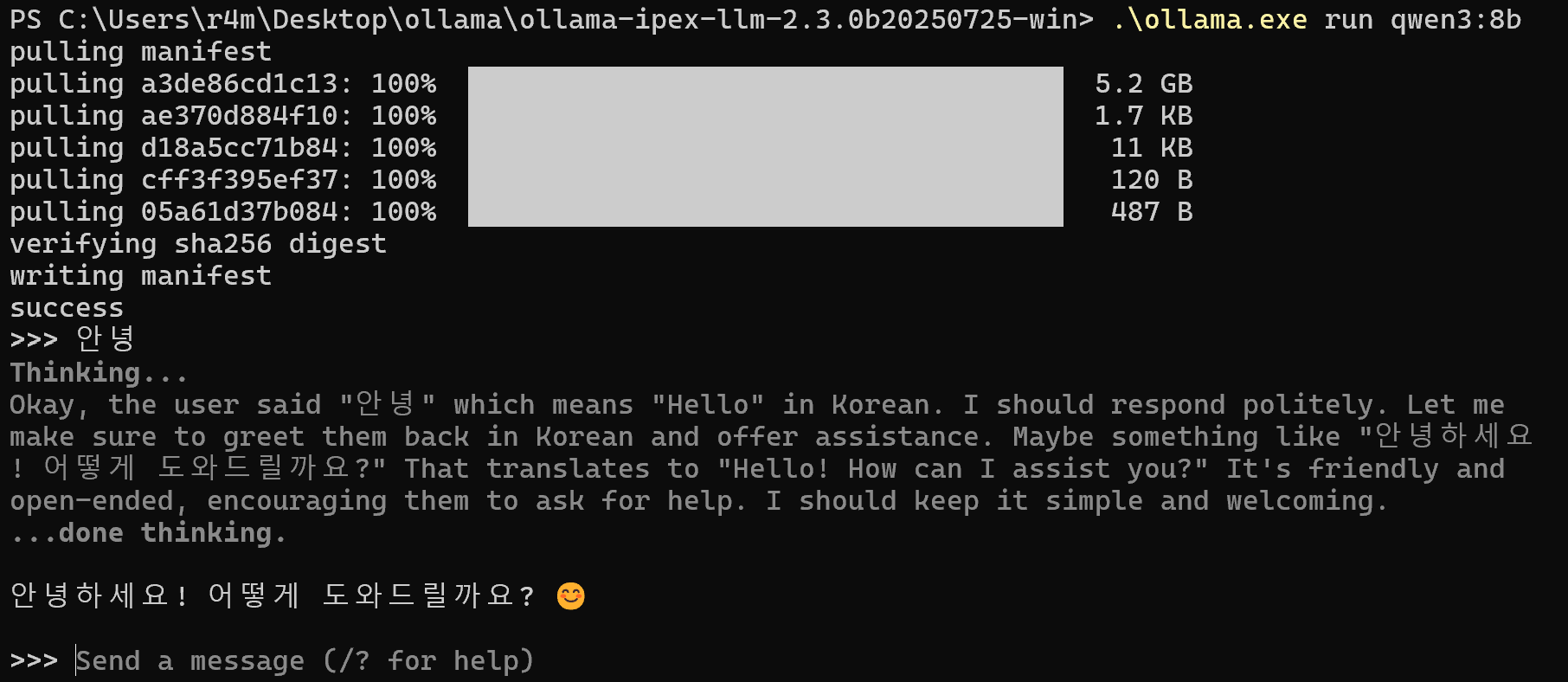

.\ollama.exe run qwen3:8b

그래서 지원 가능한 모델인 qwen3:8b 모델을 실행해보았다.

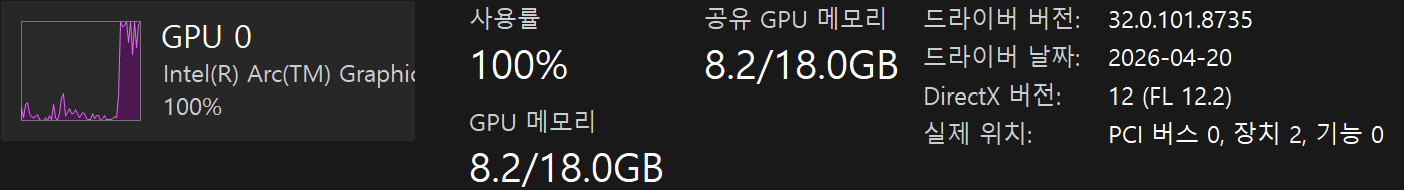

모델이 정상적으로 실행되는 것을 확인할 수 있고, 기존 Ollama 이용 시에는 사용되지 않았던 GPU가 활용되는 것을 확인할 수 있다.